Metamorphosis – Ist das Kunst oder kann das weg?

Dies sind zwar nicht meine ersten mit Hilfe von Künstlicher Intelligenz generierten Bilder, jedoch die ersten, die in einer Ausstellung zu sehen sein werden. Am kommenden Sonntag, den 23. April, findet um 15 Uhr die Vernissage zur Gemeinschaftsausstellung Panta Rhei – alles fließt in der Galerie#23 in Velbert-Langenberg, Frohnstr. 3, statt.

Seit einigen Wochen beschäftige ich mich nun mit zunehmendem Entzücken mit den neuen, KI-gestützten Bildgeneratoren. Mein Überschwang rührt wohl nicht nur von den fantastischen neuen Möglichkeiten, Bilder zu kreieren, sondern auch von der Tatsache, dass für mich persönlich hier zwei Themen meines Lebens, mit denen ich mich seit Jahrzehnten mehr oder weniger separat beschäftigt habe, zusammenfließen. Dies ist zum einen die künstlerische Fotografie und zum anderen die (heutzutage wieder so genannte) Künstliche Intelligenz, oder anders ausgedrückt, die Gebiete des Maschinellen Lernens und der Neuronalen Netze, mit denen ich mich in der Forschung befasse.

So fügt es sich wunderbar, dass ich ab kommenden Sonntag mit der Serie Metamorphosis, einer Serie von sechs Bildern (s. Abb. 1), an der Ausstellung in der Galerie#23 teilnehmen darf.

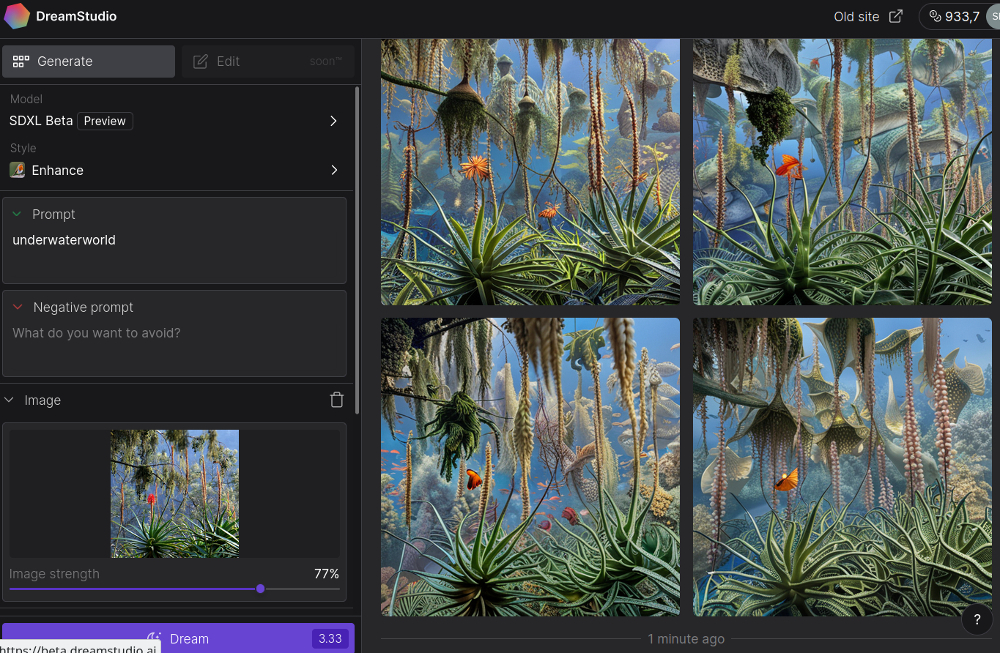

Diese Serie habe ich mithilfe von Dreamstudio, einer Web-App, die die Software Stable Diffusion nutzt, ko-kreiert – so möchte ich es einmal nennen.

Stable Diffusion stellt eine rühmliche Ausnahme unter allen

Text-zu-Bild-Generatoren dar, weil sie die bislang einzige Software ist,

Abb. 1. Metamorphosis I – IV.

Im Folgenden möchte ich einige Informationen zum Entstehungsprozess der Bilder geben. Inhaltlich hatte ich mir zum Ziel gesetzt, dass sich ein Großteil der Serie unter Wasser abspielen sollte; es sollte eine gewisse Dynamik sichtbar werden, die sich etwa in Wirbeln oder Strudeln ausdrücken sollte; und es sollte auch eine Entwicklung im Sinne einer Metamorphose in der Serie sichtbar werden. Des Weiteren war für mich klar, dass ich für die Serie eigene Fotografien als Ausgangspunkt verwenden wollte, die ich mithilfe der KI so transformieren wollte, dass das Endergebnis meinen Vorstellungen möglichst nahe kam.

Ich entschied mich für einige Fotografien aus einer Serie von Aloe, die ich vor einigen Jahren auf Madeira aufgenommen hatte, und die ich aufgrund ihrer Ästhetik, ihres Bildaufbaus, ihrer Farben und ihrer allgemeinen Atmosphäre ausgewählt hatte. Die Ästhetik dieser Bilder wollte ich in die neu zu erzeugende Serie übertragen.

Dazu bietet sich die Technik des „Seeding“ an. Eines der Bilder, die ich als Seed („Samenkorn“) verwendet habe, kennst du bereits, wenn du meinen Blog von Beginn an verfolgst. Es ist das Headerbild zu dem Beitrag „Lass dich fallen“. Generell halte ich es bei dieser Vorgehensweise für wichtig, dass ein Ausgangsbild eine besonders hohe Qualität aufweist, denn wie die alte Informatikerin weiß, gilt immer „Garbage in, Garbage out“, kurz GIGO. GIGO besagt, dass das beste Berechnungsmodell nichts taugt, wenn die eingefütterten Daten (oder auch Modellannahmen) unzureichend sind (ein Phänomen, das wir alle in den letzten drei Jahren in einer lehrbuchartigen Entfaltung beobachten konnten – aber darum soll heute nicht gehen).

Abb. 2. Erster Versuch.

Na, jedenfalls: In einem ersten Schritt habe ich das Ausgangsfoto zunächst durch die Eingabe eines simplen Textes (sogar mit Rechtschreibfehler) und die Angabe, dass das Seed-Bild zu 77% in das Ergebnis eingehen möge, mal eben in ein Unterwasser-Bild transformiert. Obwohl schon die innerhalb weniger Sekunden erzeugten Ergebnisse leichte Glücksgefühle bei mir erzeugten, waren sie mir um Einiges zu künstlich (s. Abb. 2). Denn obwohl man den finalen Bildern ansehen sollte, dass es sich nicht um Fotografien handelt, war mir dieser erste Aufschlag deutlich zu poppig.

Abb. 3. Etwas mehr Tiefe, etwas mehr Fotorealismus, noch recht statisch.

Also spielte ich in der Folge durch Erweiterungen des sog. Prompts mit dem Grad des Fotorealismus, mit der Vermittlung von Tiefe durch eine veränderte Farbgebung und mit dem Hinzufügen von Dynamik (s. Abb. 3 und 4).

(Mittlerweile hat sich die Bedeutung des Begriffs Prompt von „Eingabeaufforderung“ hin zu „Texteingabe für sprachbasierte KI-Bots“ gewandelt.)

Auch in früheren Projekten habe ich immer gern mit Extremen gespielt, um den Anwendungsbereich einer Technik, eines Parameterbereichs oder auch einer Idee auszuloten. Abb. 5 und 6 geben Zwischenergebnisse beim Ausloten des Aspekts der Dynamik wieder.

Abb. 4. Mehr Tiefe, mehr Fotorealismus, etwas mehr Dynamik.

Abb. 5. Viel Dynamik.

Abb. 6. Ganz viel Dynamik.

Beispiele für Ergebnisse, die meinen Wünschen bzgl. Realismus, Tiefe und Dynamik schon recht nahe kamen, sind in Abb. 7 wiedergegeben.

Abb. 7. Schon nah dran an meinen Zielvorstellungen.

Die finale Serie Metamorphosis I-IV würde ich als eine „Studie zu einer ersten Auslotung einer neuen Kulturtechnik“ bezeichnen. Ich freue mich bereits jetzt darauf, größere (und ganz andere) Projekte mithilfe der neuen Bildgeneratoren umzusetzen, insbesondere solche, die ich schon seit langer Zeit mit mir herumtrage und deren Realisierung für mich erst jetzt durch die neuen Möglichkeiten in greifbare Nähe rücken.

Die Zeitersparnis im kreativen Prozess ist einfach enorm. Die Zeit vom ersten Brainstorming für dieses Projekt bis zum Hochladen der Bilder bei einem Dienstleister zum Printen und Rahmen (hier schwöre ich auf Whitewall) betrug 2 Tage, wovon ich einen mit wunderbar nutzlosen Spielereien verbracht habe.

Eine Entschuldigung, die mich lange davon abgehalten hat, meine 22 Jahre alte Fotografie-Website in die Gegenwart zu befördern, gilt nun übrigens auch nicht mehr, nämlich das Problem, die dort ausgestellten Bilder sämtlich neu erstellen zu müssen, um sie in einer angemessenen Auflösung präsentieren zu können. Dank KI stellt das Upscaling nun kein Problem mehr dar. (Meine Empfehlung wäre für diese Zwecke PhotoAI von Topaz Labs.)

Was meinst du?

Ist das Kunst? Oder kann das weg?

Schreib’s mal unten in die Kommentare!

Und da ich mich zwischendurch immer wieder von meinem selbstgesetzten Thema habe ablenken lassen, ist nebenbei eine (unfassbar große) Menge von Bildern quasi am Wegesrand des Prozesses entstanden, von denen ich hier zum Schluss noch einige wiedergeben möchte – Have fun!

Die gesamte Ausstellung Panta Rhei – alles fließt mit vielen weiteren Arbeiten von Werner Barfus, Marlies Blauth, Petra Fröning, Peter von Malotki, Sabine Odensaß, Andrea Thierbach und Thorsten Trapp kann ab Sonntag bis zum 9. Juli in der Galerie#23 gesehen werden. Am darauffolgenden Sonntag findet in der Galerie eine Lesung zum Ausstellungsthema statt. Infos dazu gibt es auf der Seite der Galerie: http://www.galerie-23.de/.

Das könnte dir auch gefallen

Todo Cambia – Alles verändert sich

13. Dezember 2021

Auf 2 und 4 in den Sommer

21. Juli 2022